I. La parabole

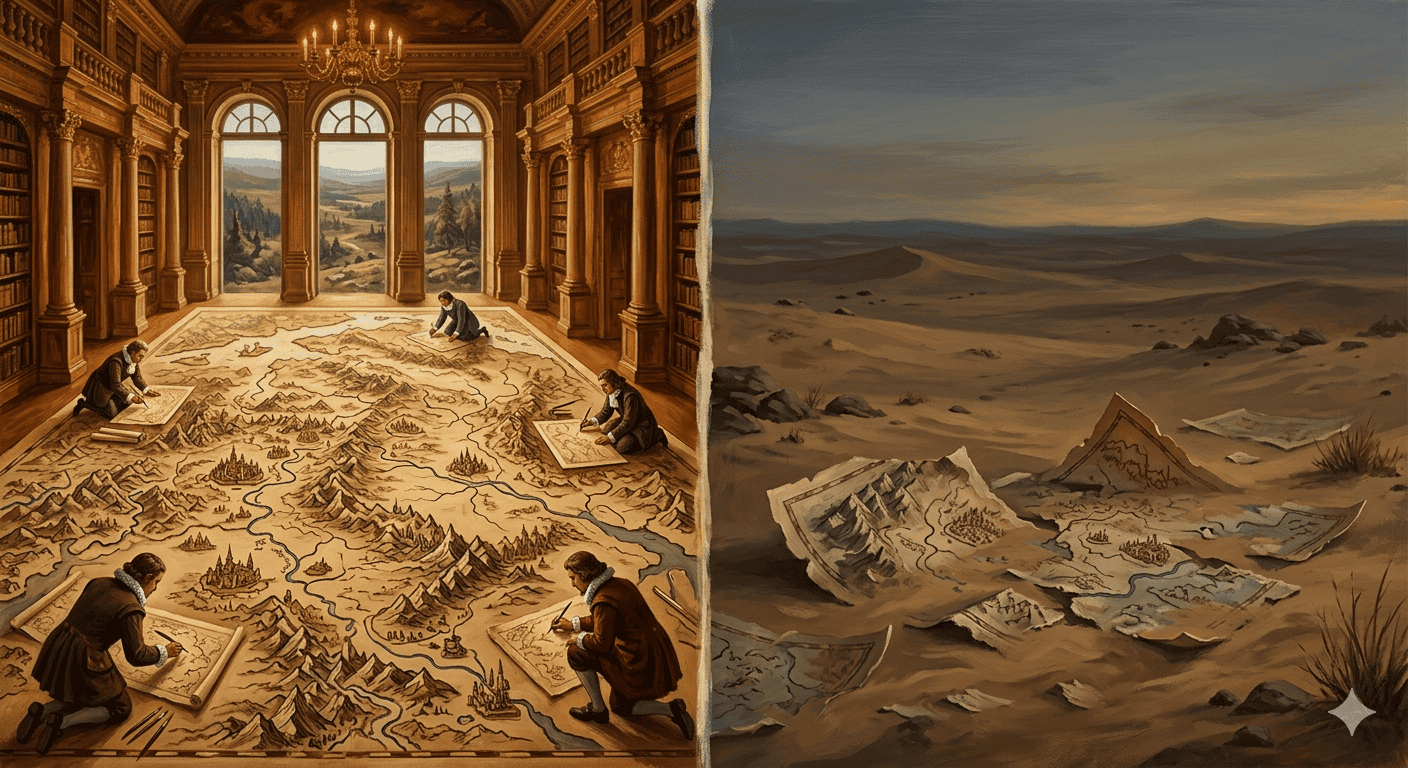

En 1946, Jorge Luis Borges publia une parabole de six phrases. Il l’attribua à un voyageur fictif — Suárez Miranda — et l’enfouit dans El Hacedor, un recueil que ses admirateurs appelleraient L’Auteur et autres textes. La parabole décrit un empire dont les cartographes, insatisfaits de toutes les cartes précédentes, en bâtirent une à la seule échelle qui ne peut mentir : une province pour une province, point pour point. La carte était complète. Elle était aussi inutile. Les générations suivantes, avec des priorités plus pratiques, la laissèrent se décomposer dans les déserts de l’ouest.

Borges l’appela Del rigor en la ciencia — « De la rigueur en science ». Il écrivait sur l’épistémologie, sur l’hubris de la représentation parfaite. Il écrivait aussi, sans le savoir, le prologue d’un article qui n’existerait que soixante et onze ans plus tard.

Jean Baudrillard ouvrit Simulacres et Simulation (1981) sur cette même parabole — puis l’inversa. Pour Borges, la carte succède au territoire et finit par s’y substituer dans l’esprit de ses utilisateurs. Pour Baudrillard, dans le monde de la télévision et de la publicité, c’est désormais le territoire qui succède à la carte : la simulation précède le réel, le génère, le remplace. Les LLM sont l’accomplissement littéral de cette prophétie. Ils ne représentent pas le monde. Ils représentent l’intégralité de ce que les humains ont écrit sur le monde, à une résolution si fine qu’ils peuvent produire, à la demande, du langage indiscernable du leur.

II. Comment nous avons construit la carte — rétropropagation, attention, échelle

En 2017, huit chercheurs de Google publièrent Attention Is All You Need. Ce n’était pas, à première vue, un article dramatique. Il proposait une nouvelle architecture pour la modélisation de séquences. Mais trois choses convergèrent, et la convergence fut l’événement.

La première était la rétropropagation. En 1986, Hinton, Rumelhart et Williams donnèrent leur moteur aux réseaux de neurones : une méthode pour ajuster des millions de paramètres en mesurant l’erreur de chaque prédiction et en la propageant vers l’arrière, corrigeant chaque poids en proportion de sa contribution à la faute. Sans rétropropagation, pas d’apprentissage profond. Pendant deux décennies après 1986, elle produisit des classifieurs d’images et des reconnaisseurs vocaux. Elle ne produisit pas de langage.

La deuxième était le goulot d’étranglement séquentiel. Les modèles de langage antérieurs à 2017 lisaient le texte mot à mot, chaque prédiction attendant la précédente. Ce n’était pas seulement lent. Le gradient qui s’évanouit faisait que le réseau oubliait le début d’une phrase avant d’en atteindre la fin. Plus important : l’architecture sérielle rendait impossible l’utilisation des fermes GPU modernes. Des milliers de processeurs parallèles restaient inactifs pendant que le modèle attendait le mot n−1 pour commencer le mot n. Entraîner un modèle sur l’internet entier aurait pris des siècles.

L’article de Vaswani supprima le goulot. L’auto-attention permettait au modèle de regarder chaque mot d’une phrase simultanément — calculant, en une seule passe, à quel point chaque mot est lié à chaque autre. L’exemple classique : « L’animal n’a pas traversé la rue parce qu’il était trop fatigué. » À quoi renvoie il ? L’auto-attention relie il directement à animal, sans récurrence, en pondérant chaque paire de tokens dans la séquence l’un contre l’autre. Le calcul est parallélisable à l’extrême. On peut le faire tourner sur dix mille cœurs GPU simultanément.

Une fois le plafond de parallélisation levé, une troisième force devint opérante : l’hypothèse d’échelle. The Bitter Lesson de Rich Sutton (2019) et les Scaling Laws for Neural Language Models de Kaplan et al. (2020) firent la même observation empirique depuis des angles différents : le levier le plus fiable pour améliorer un modèle de langage est l’échelle — plus de paramètres, plus de données, plus de calcul. Presque rien d’autre n’importe autant. Common Crawl, Wikipédia, Reddit, chaque livre numérisé, chaque preprint d’arxiv. Tout à l’intérieur. La carte continuait de grandir.

Le génie ne fut pas un seul article. Ce fut la compréhension que l’attention rendait possible l’échelle, et que l’échelle produisait la carte.

III. Ce qu’est vraiment la carte

À la fin de l’entraînement, un grand modèle de langage est une compression statistique de l’intégralité du corpus écrit numérisé de l’espèce humaine. Pas une métaphore. Les paramètres sont, littéralement, les relations entre chaque concept qui a jamais été écrit — pondérées par la fréquence de co-occurrence, la force de prédiction mutuelle, la stabilité des associations sur des milliards de tokens de texte. Le modèle contient la forme de chaque argument, la cadence de chaque registre, les objections canoniques à chaque position. Il contient ce que les humains fluents tendent à dire sur le monde.

C’est la carte 1:1. Peut-être plus dense encore.

Elle ne contient pas, et n’est pas construite pour contenir, le monde sur lequel ces humains fluents écrivaient. Un modèle qui a absorbé tous les articles de climatologie possède la carte du discours climatologique — le vocabulaire, les cadres, les débats canoniques, les erreurs typiques. Il n’a pas le climat. Un modèle qui a lu toutes les décisions de justice possède la carte du raisonnement juridique ; il n’a pas l’affaire devant lui. Un modèle qui a lu tous les récits du deuil possède la carte du deuil ; il n’a pas pleuré.

Ce n’est pas une déficience. C’est une description de ce qu’est l’artefact.

IV. L’erreur catégorielle qui ronge la conversation

L’erreur catégorielle qui ronge la conversation publique sur l’IA consiste à traiter la fluidité sur le monde comme une connaissance du monde.

La distinction a toujours existé. Ce qui est nouveau, c’est son échelle. Quand un être humain confond ce qu’il a lu sur un sujet avec le sujet lui-même, c’est une erreur familière et corrigible — la « carte n’est pas le territoire » de Korzybski, l’étudiant qui a absorbé la bibliographie secondaire sans rencontrer le phénomène primaire. Quand une machine peut produire, à la demande, un discours arbitrairement fluide sur n’importe quel sujet, et quand cette fluidité suffit à passer pour de l’expertise dans la plupart des contextes à faible friction, la confusion devient systémique.

Le danger n’est pas que les LLM se trompent. Ils le font, parfois, et ce problème est largement mécanique — meilleure récupération, meilleur ancrage dans des sources vérifiables. Le danger est qu’ils sont suffisamment persuasifs pour nous faire oublier de vérifier le territoire. Chaque benchmark dépassé, chaque nouvelle capacité démontrée, chaque article sur le raisonnement émergent : la carte devient plus détaillée. Ce qu’il devient de plus en plus difficile de rappeler, c’est qu’aucun de ces progrès ne va en direction du territoire. Ils vont en direction d’une carte plus complète.

Il y a un nom pour ce qui se passe quand une carte devient assez détaillée pour commencer à remplacer le territoire dans l’esprit de ses utilisateurs. Baudrillard l’avait en 1981 : l’hyperréel, le simulacre qui précède et engendre son référent. Borges l’avait en 1946 : le désert.

La juste relation à la carte — celle que Borges prescrivit par implication, en laissant la carte se décomposer dans le sable — n’est pas la méfiance. Une compression consultable de tout ce que les humains ont jamais écrit est une réalisation culturelle réelle : le premier artefact de l’histoire qui nous restitue, sous forme navigable, notre propre discours collectif. La juste relation est l’orientation. La carte est un outil pour se déplacer plus vite dans un terrain déjà connu. Au moment où l’on cesse de vérifier si la carte concorde avec ce que l’on voit par le pare-brise, la carte n’est plus de la navigation. C’est de la fiction.

Et les endroits où la carte et le territoire divergent le plus nettement — les questions auxquelles le modèle répond avec une fluidité inhabituelle mais une uniformité inhabituellement lisse — sont précisément là où vit le monde que nous n’avons pas encore écrit.

C’est là que tout ce qui est vraiment intéressant se passe encore.

Pour aller plus loin

- Jorge Luis Borges — L’Auteur et autres textes (El Hacedor) (1960)

- Vaswani et al. — Attention Is All You Need (2017)

- Hinton, Rumelhart & Williams — Learning Representations by Back-Propagating Errors (1986)

- Kaplan et al. — Scaling Laws for Neural Language Models (2020)

- Rich Sutton — The Bitter Lesson (2019)

- Jean Baudrillard — Simulacres et Simulation (1981)

- Alfred Korzybski — Science and Sanity (1933)