I. La parábola

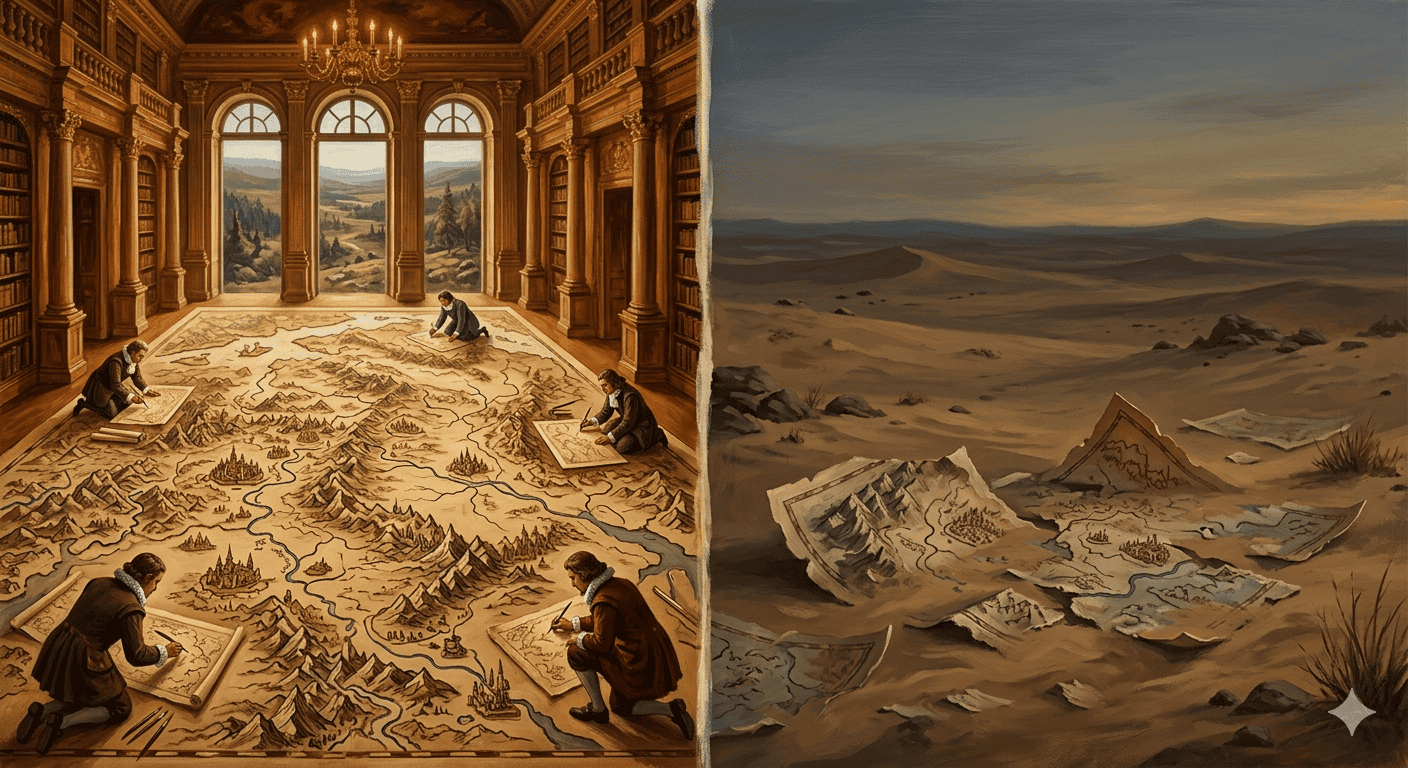

En 1946, Jorge Luis Borges publicó una parábola de seis oraciones. La atribuyó a un viajero inventado — Suárez Miranda — y la enterró en El Hacedor como si fuera un hallazgo arqueológico menor. La parábola describe un imperio cuyos cartógrafos, insatisfechos con todos los mapas anteriores, levantaron uno a la única escala que no puede mentir: una provincia por provincia, punto por punto. El mapa era completo. También era inútil. Las generaciones siguientes, con prioridades más prácticas, lo dejaron pudrirse en los desiertos del oeste.

Borges lo llamó Del rigor en la ciencia. Escribía sobre epistemología, sobre la soberbia de la representación perfecta. También escribía, sin saberlo, el prólogo de un artículo que no existiría sino setenta y un años después.

II. Cómo construimos el mapa — retropropagación, atención, escala

En 2017, ocho investigadores de Google publicaron Attention Is All You Need. No era, a primera vista, un artículo dramático. Proponía una nueva arquitectura para el modelado de secuencias. Pero tres cosas convergieron, y la convergencia fue el acontecimiento.

La primera fue la retropropagación. En 1986, Hinton, Rumelhart y Williams le dieron motor a las redes neuronales: un método para ajustar millones de parámetros midiendo el error de cada predicción y propagándolo hacia atrás, corrigiendo cada peso según su contribución al fallo. Sin retropropagación no hay aprendizaje profundo. Durante dos décadas después de 1986, produjo clasificadores de imágenes y reconocedores de voz. No produjo lenguaje.

La segunda fue el cuello de botella secuencial. Los modelos de lenguaje anteriores a 2017 leían texto palabra por palabra, cada predicción esperando a la anterior. Esto no era solo lento. El gradiente que se desvanece hacía que la red olvidara el comienzo de una oración antes de llegar al final. Más importante: la arquitectura serial hacía imposible usar granjas de GPU modernas. Miles de procesadores paralelos quedaban ociosos mientras el modelo esperaba la palabra n−1 para poder comenzar con la n. Entrenar con internet habría tomado siglos.

El artículo de Vaswani eliminó el cuello de botella. La autoatención permite al modelo leer cada palabra de una oración simultáneamente — calculando, en un solo paso, cuánto se relaciona cada palabra con cada otra. El ejemplo clásico: “El animal no cruzó la calle porque estaba demasiado cansado.” ¿A qué se refiere estaba? La autoatención vincula el verbo directamente al animal, sin recurrencia, ponderando cada par de tokens entre sí. El cálculo es paralelizable. Se puede ejecutar sobre diez mil núcleos de GPU a la vez.

Una vez eliminado el techo de paralelización, una tercera fuerza se volvió operativa: la hipótesis de escala. The Bitter Lesson de Rich Sutton (2019) y las Scaling Laws for Neural Language Models de Kaplan et al. (2020) hicieron la misma observación empírica desde ángulos distintos: la palanca más confiable para mejorar un modelo de lenguaje es la escala — más parámetros, más datos, más cómputo. Casi nada más importa tanto. Common Crawl, Wikipedia, Reddit, cada libro digitalizado, cada preprint de arxiv. Todo adentro. El mapa seguía creciendo.

El genio no fue ningún artículo en particular. Fue la comprensión de que la atención habilitaba la escala, y la escala producía el mapa.

III. Lo que el mapa realmente es

Al final del entrenamiento, un modelo de lenguaje grande es una compresión estadística del registro escrito digitalizado de la especie humana. No una metáfora. Los parámetros son, literalmente, las relaciones entre cada concepto que alguna vez se escribió — ponderadas por la frecuencia de co-ocurrencia, la fuerza de predicción mutua, la estabilidad de las asociaciones a lo largo de miles de millones de tokens de texto. El modelo contiene la forma de cada argumento, la cadencia de cada registro, las objeciones canónicas a cada posición. Contiene lo que los humanos fluidos tienden a decir sobre el mundo.

Este es el mapa 1:1. Posiblemente más denso.

No contiene, y no está construido para contener, el mundo sobre el que esos humanos fluidos escribían. Un modelo que absorbió todos los artículos de climatología tiene el mapa del discurso climatológico — el vocabulario, los marcos, los debates canónicos, los errores típicos. No tiene el clima. Un modelo que leyó todas las opiniones legales tiene el mapa del razonamiento jurídico; no tiene el caso frente a él. Un modelo que leyó todos los relatos del duelo tiene el mapa del duelo; no ha llorado a nadie.

Esto no es una deficiencia. Es una descripción de lo que el artefacto es.

IV. El error categorial que corroe la conversación

El error categorial que corroe la conversación pública sobre la IA es tratar la fluidez sobre el mundo como conocimiento del mundo.

La distinción siempre existió. Lo nuevo es la escala. Cuando un ser humano confunde lo que leyó sobre un tema con el tema mismo, es un error familiar y corregible — el mapa no es el territorio de Korzybski, el estudiante que absorbió la bibliografía secundaria sin encontrarse con el fenómeno primario. Cuando una máquina puede producir, a demanda, discurso arbitrariamente fluido sobre cualquier materia, y cuando esa fluidez alcanza para pasar por expertise en la mayoría de los contextos de baja fricción, la confusión se vuelve sistémica.

El peligro no es que los LLM se equivoquen. Lo hacen, a veces, y ese problema es mayormente mecánico — mejor recuperación, mejor anclaje en fuentes verificables. El peligro es que son suficientemente persuasivos como para hacernos olvidar verificar el territorio. Cada benchmark superado, cada nueva capacidad demostrada, cada artículo sobre razonamiento emergente: el mapa se vuelve más detallado. Lo que se hace más difícil recordar es que ninguno de esos avances ocurre en dirección al territorio. Ocurren en dirección a un mapa más completo.

Hay un nombre para lo que sucede cuando un mapa se vuelve tan detallado que empieza a reemplazar el territorio en la mente de sus usuarios. Borges lo tenía en 1946. Lo llamó el desierto.

La relación correcta con el mapa — la que Borges prescribió por implicación, al dejar que el mapa se pudriera en la arena — no es la desconfianza. Una compresión consultable de todo lo que los humanos hemos escrito es un logro cultural real: el primer artefacto en la historia que nos devuelve, en forma navegable, nuestro propio discurso colectivo. La relación correcta es la orientación. El mapa es una herramienta para moverse más rápido por un terreno ya conocido. El momento en que dejamos de verificar si el mapa coincide con lo que vemos por el parabrisas, el mapa deja de ser navegación. Se convierte en ficción.

Y los lugares donde el mapa y el territorio más se separan — las preguntas que el modelo responde con fluidez inusual pero con uniformidad inusual — son exactamente donde vive el mundo que todavía no hemos escrito.

Ahí es donde todavía pasan las cosas realmente interesantes.

Lecturas recomendadas

- Jorge Luis Borges — El Hacedor (1960)

- Vaswani et al. — Attention Is All You Need (2017)

- Hinton, Rumelhart y Williams — Learning Representations by Back-Propagating Errors (1986)

- Kaplan et al. — Scaling Laws for Neural Language Models (2020)

- Rich Sutton — The Bitter Lesson (2019)

- Alfred Korzybski — Science and Sanity (1933)